안정적 AI 활용을 위한 리스크 통제 체계

AI 활용 전 과정에서 발생 가능한 리스크를 선제적으로 식별·평가·통제하여

금융 서비스의 신뢰성과 안정성을 확보합니다.

목적

리스크 선제적 식별 및 통제를 통한 안정적 활용 기반 확보

적용 범위

내부 개발 AI, 외부/클라우드 AI, 생성형 AI(LLM) 포함 (단순 자동화 중 모델 포함 시 적용)

관리 대상

9대 핵심 리스크 및 법적 준수 의무 (AI기본법 투명성/고영향 책무 등)

9대 AI 핵심 리스크

금융기관이 중점적으로 관리해야 할 9가지 핵심 리스크 정의

1. 성능 (Performance)

의도된 성능 기준 미충족 또는 환각 현상(Hallucination) 발생

2. 공정성 (Fairness)

특정 집단이나 개인에 대한 차별적 결과 도출

3. 설명가능성 (Explainability)

결과의 근거를 합리적으로 설명하지 못할 리스크

4. 데이터 보호 (Data Protection)

개인정보/신용정보 오용 및 유출

5. 사이버 보안 (Cyber Security)

외부 공격(적대적 예제 등)으로 인한 오작동

6. 지식재산권 (IP)

타인 지식재산권 침해 리스크

7. 제3자 리스크 (3rd Party)

위수탁 및 외부 솔루션 사용에 따른 리스크

8. 유해성 (Harmfulness)

불법적이거나 비윤리적인 콘텐츠 생성

9. 통제 가능성 (Controllability)

인간의 관리/감독 범위를 벗어날 리스크

법적 준수 의무 (AI 기본법)

- 투명성 확보 (제31조): AI 사용 사실 사전 고지 및 결과물 표시

- 고영향 AI 책무 (제34조): 관리 방안 수립, 사람의 개입(Human-in-the-loop), 설명 방안 마련

AI 리스크 등급 분류

기획 단계에서 1차 판단 후, 거버넌스 주관부서가 확인합니다.

저리스크 (Low)

일반 AI 서비스

(고/중 리스크 미해당)

- 기본 모니터링

- 필수 점검 항목만 평가 (선택적)

- 법적 의무 준수

중리스크 (Medium)

민감정보(개인신용정보)나

영업비밀 취급 서비스

- 개인정보보호 조치 강화

- 데이터/모델 보안성 검토

- 개발자 자체 품질 검증

- 윤리위 보고 (선택적 심의)

고리스크 (High)

법적 고영향 AI,

권익/평판 중대 영향

- AI 윤리위원회 심의 필수 (기획/배포)

- 제3자 검증 필수

- 고지, 설명, 보호, 감독 등 법적 의무 전면 준수

- 홈페이지 공시 의무

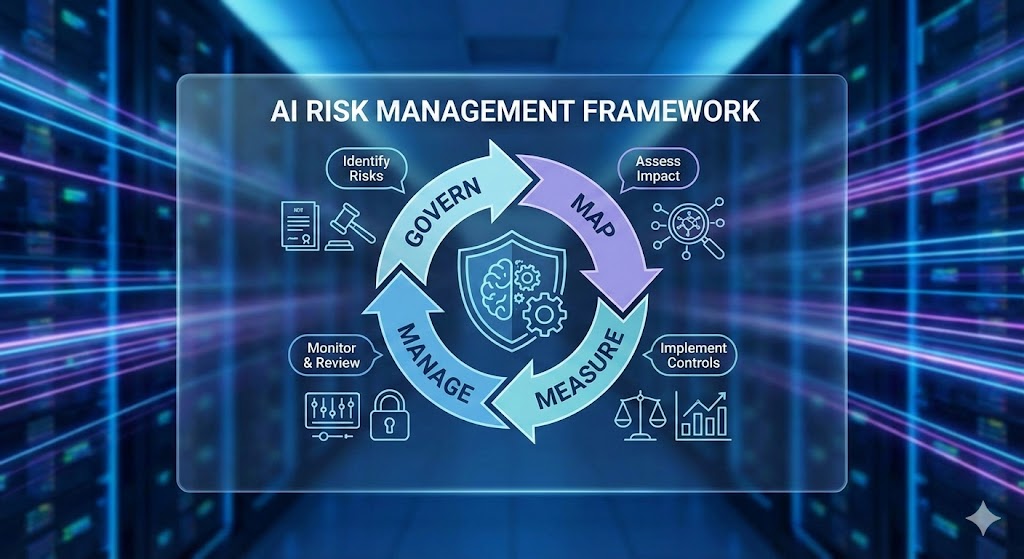

리스크 관리 프로세스

AI 서비스 생애주기에 맞춘 단계별 통제 절차

기획 단계

Planning• 리스크 등급 분류 확정

• 체크리스트 수행 (기획용)

• 고리스크: 윤리위 심의/승인 필수

개발 단계

Development• 데이터 품질/편향성 점검

• 모델 기능 테스트

• 체크리스트 수행 (개발용)

평가·검증 단계

Verification• 개발자 자체 검증

• 고리스크: 제3자 검증 수행

• 주관부서 이관 승인

운영 단계

Operation• 상시 모니터링 (오류/민원)

• 정기 리스크 평가 (연 1회)

• 이슈 발생 시 윤리위 보고

거버넌스 체계

AI 리스크관리는 3 Lines of Defense 체계를 기본으로 하며, 고리스크 사례에 대해 AI 윤리위원회의 별도 심의 및 승인을 진행합니다.

AI 윤리위원회

고리스크 AI 개발 착수 및 배포 승인 심의, 중대 이슈 발생 시 조치 권고

(현업)

실행부서 (개발·운영)

AI 서비스 기획/개발/운영 수행, 단계별 체크리스트 작성, 리스크 완화 조치 이행

(총괄)

AI 거버넌스 주관부서

프로세스 총괄 운영, 리스크 등급/평가 결과 검토, 윤리위 안건 상정, 제3자 검증 주관

(지원)

지원·통제 부서

(감사)

감사 부서

리스크 관리 체계 적정성 및 운영 실효성 점검